El rápido avance de la inteligencia artificial (IA) está teniendo un impacto transformador en numerosos campos científicos, abriendo nuevas fronteras para la investigación en diversas disciplinas. La IA puede revolucionar los descubrimientos científicos, acelerar el progreso de la investigación e impulsar la innovación, facilitando desde el análisis exhaustivo de datos experimentales hasta la generación de nuevas hipótesis científicas a partir de la literatura existente.

El informe de revisión de la Scientific Advice Mechanism para la Comisión Europea presenta sus conclusiones acerca de la inteligencia artificial (IA) referentes a la ciencia en la Unión Europea. Estos son algunos de sus apartados más destacables.

¿Qué es la IA?

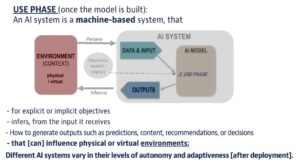

No existe una definición común, ya que el de la IA es un campo en rápida evolución y su reciente crecimiento ha puesto en tela de juicio muchas de las definiciones que han intentado enmarcarla. Sin embargo, los gobiernos necesitan una definición común para regularla eficazmente y facilitar la colaboración entre los distintos países. Los miembros de la OCDE acordaron en noviembre 2023 la siguiente definición:

Un sistema de IA es un sistema basado en una máquina que puede deducir, a partir de los datos de entrada que recibe, cómo generar predicciones, contenidos, recomendaciones o decisiones que pueden influir en entornos físicos o virtuales. Los distintos sistemas de IA funcionan con distintos niveles de autonomía y capacidad de adaptación tras el despliegue de opciones políticas basadas en la evidencia.

Panorama normativo

En todo el mundo están surgiendo numerosas medidas legales y reguladoras específicas de la IA, aunque muchos países aún no han promulgado una legislación exhaustiva al respecto. La mayoría de los países se basan en los marcos existentes para la regulación, complementados por directrices de gobernanza. En octubre de 2023, 31 países habían promulgado leyes sobre IA, mientras que otros 13 están debatiendo posibles normativas. La UE y China están a la cabeza en el desarrollo de normativas exhaustivas sobre IA. China ha estado a la vanguardia de la regulación, promulgando medidas específicas para el sesgo algorítmico, el uso responsable de la IA generativa y una supervisión más sólida de la tecnología de síntesis profunda. En la UE, se ha prestado una atención considerable a su Ley de IA, descrita por la Comisión Europea como la legislación sobre IA más completa del mundo. Más recientemente, la política de IA de EE.UU. ha visto la publicación de varias reformas con mandato legal.

Oportunidades y beneficios de la IA en la ciencia

La creciente accesibilidad de la IA generativa y otras herramientas de aprendizaje automático para el análisis de grandes volúmenes de datos ha llevado a científicos de diversas disciplinas a incorporarlas a sus investigaciones. Estas herramientas facilitan el análisis de grandes cantidades de texto, código, imágenes y datos específicos de cada campo, lo que permite a los científicos generar nuevas ideas, conocimientos y soluciones.

El número de proyectos científicos que incorporan la IA prolifera, con ejemplos de éxito en la ingeniería de proteínas, el diagnóstico médico y la predicción meteorológica. Además de facilitar descubrimientos revolucionarios, la IA también está transformando el trabajo académico diario de los científicos, desde el apoyo a la redacción de manuscritos hasta la generación de códigos.

En el ámbito de las humanidades, la IA ayuda a los historiadores a rastrear la historia y el patrimonio de los últimos 400 años en textos e imágenes. Los recientes avances en el aprendizaje profundo han ayudado a los historiadores a detectar patrones en grandes y complicados conjuntos de datos de documentos mal escritos a mano o impresos, lenguas primitivas y dialectos, como muestra el proyecto ITHACA para el caso de las inscripciones griegas antiguas.

En las ciencias medioambientales, de la tierra y agrícolas, existe una amplia gama de tecnologías de IA, como el aprendizaje automático, las redes neuronales, los macrodatos, la robótica y el procesamiento de imágenes, para satisfacer las demandas modernas de evaluación, planificación y prácticas inteligentes urbanas y rurales, incluida la sostenibilidad y la mitigación del cambio climático.

En biología, las limitaciones humanas en áreas como la recopilación y la integración de datos han provocado la división del campo en subdisciplinas altamente especializadas, mientras que las tecnologías de IA tienen el potencial de ayudar a los investigadores a integrar los conocimientos existentes, aprendiendo a traducir grandes cantidades de datos a formatos accesibles, lo que proporcionaría a los investigadores información más completa y actualizada sobre el problema que están investigando y aumentaría la eficiencia de la investigación.

Reproducibilidad, interpretabilidad y transparencia limitadas

El uso de la IA en la ciencia agrava las preocupaciones existentes sobre la reproducibilidad, mientras que la opacidad de los algoritmos de IA también plantea retos importantes para la integridad científica, la interpretabilidad y la confianza del público. Los algoritmos de IA pueden generar resultados útiles, pero su naturaleza opaca dificulta la verificación de la exactitud y validez de los resultados de la investigación. La falta de transparencia de los algoritmos de IA dificulta la reproducibilidad, ya que los investigadores no pueden reproducir descubrimientos importantes sin conocer o comprender los procesos metodológicos subyacentes. La opacidad de los algoritmos de IA plantea problemas de responsabilidad y confianza, sobre todo en aplicaciones de alto riesgo como la asistencia sanitaria.

La creciente prevalencia de modelos generativos de IA y sistemas de visión por ordenador producidos por la industria suscita preocupación por su opacidad y la falta de control sobre la evaluación humana por parte de los investigadores académicos. La falta de acceso a canales escalables, de información humana a gran escala o de datos dificulta la capacidad de los investigadores académicos para evaluar la seguridad, la ética y los sesgos sociales de los modelos de aprendizaje automático. La dificultad de crear modelos de IA de vanguardia debido a la escasez de recursos informáticos y de ingeniería lleva a depender de modelos comerciales, lo que limita la reproducibilidad y el avance fuera de los entornos comerciales. Además, la monopolización de las capacidades de IA por parte de los gigantes tecnológicos suscita preocupación por el control que ejercen sobre el desarrollo y la aplicación de las nuevas tecnologías.

Uso indebido (agentes malintencionados) y daños no deseados

El uso indebido de la IA en la comunicación académica puede provocar daños sociales importantes, como la proliferación de información errónea, la creación de productos de baja calidad y el plagio. Esto conllevaría una clara falta de ética investigadora.

Los contenidos generados por IA pueden ser difíciles de distinguir de los generados por humanos, lo que aumenta el riesgo de difundir información errónea. Las revistas depredadoras y las fábricas de artículos pueden utilizar la IA para crear artículos de investigación fraudulentos. La IA puede facilitar el plagio de contenidos, violando potencialmente los derechos de autor y otros derechos de propiedad intelectual. La facilidad para producir contenidos generados por IA puede conducir a un aumento del número de artículos irrelevantes, lo que puede erosionar la confianza en los hallazgos científicos. Las herramientas basadas en IA pueden falsificar información, lo que podría conducir a una mala conducta en la investigación. El uso de la IA para generar contenidos puede rebajar el listón de la calidad científica exigida al trabajo original.

A día de hoy, los resultados de la IA siguen siendo mediocres a la hora de evaluar la calidad de la investigación, ya que carece de los profundos conocimientos de los revisores humanos, de su capacidad para captar el sentido, la importancia y la comprensión humana. Estas características ciertamente humanas nunca podrán sustituirse por la IA.